Stories

-

نبض الملاعب

RT STORIES

أول تعليق من المصري حمزة عبد الكريم بعد فوزه مع برشلونة بلقب "لاليغا".. فيديو

#اسأل_أكثر #Question_MoreRT STORIES

شاهد.. مقاتل بحريني روسي ينهار في القفص

![شاهد.. مقاتل بحريني روسي ينهار في القفص]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

كواليس الصفقة.. رونالدو كاد يرتدي قميص برشلونة ليلعب بجوار ميسي

![كواليس الصفقة.. رونالدو كاد يرتدي قميص برشلونة ليلعب بجوار ميسي]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

أول تعليق من رونالدو بعد الهزيمة الثقيلة في "معركة القادسية"

![أول تعليق من رونالدو بعد الهزيمة الثقيلة في "معركة القادسية"]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

خيار مفاجئ.. "يويفا" يحدد حكم المواجهة "الحاسمة" بين بايرن ميونخ وباريس سان جيرمان

![خيار مفاجئ.. "يويفا" يحدد حكم المواجهة "الحاسمة" بين بايرن ميونخ وباريس سان جيرمان]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

رافينيا يحسم موقفه من عرض سعودي مغر

![رافينيا يحسم موقفه من عرض سعودي مغر]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

سيدات برشلونة على بعد خطوة من المجد القاري

![سيدات برشلونة على بعد خطوة من المجد القاري]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

توتر داخل ريال مدريد بسبب تصرف مبابي الأخير

![توتر داخل ريال مدريد بسبب تصرف مبابي الأخير]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

تغييرات فنية في تسيسكا موسكو قبل نهائي الكأس

#اسأل_أكثر #Question_MoreRT STORIES

أول رد رسمي من برشلونة بشأن مستقبل "هالاند مصر"

![أول رد رسمي من برشلونة بشأن مستقبل "هالاند مصر"]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

توقيف لاعب بعد الاعتداء على حكم خلال مباراة في تركيا

![توقيف لاعب بعد الاعتداء على حكم خلال مباراة في تركيا]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

مونديال 2030 على أعتاب ثورة كروية.. ماذا يخطط الفيفا؟

![مونديال 2030 على أعتاب ثورة كروية.. ماذا يخطط الفيفا؟]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

إلغاء نزال على لقب عالمي بعد حادثة أمنية داخل قاعة ملاكمة

![إلغاء نزال على لقب عالمي بعد حادثة أمنية داخل قاعة ملاكمة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

8 ميداليات تضع روسيا في المركز الثاني عالميا في السباحة الإيقاعية

![8 ميداليات تضع روسيا في المركز الثاني عالميا في السباحة الإيقاعية]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

أوسيك وفيرهوفن في نزال تاريخي تحت أهرامات الجيزة

![أوسيك وفيرهوفن في نزال تاريخي تحت أهرامات الجيزة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_Moreنبض الملاعب

-

![هدنة وحصار المضيق]()

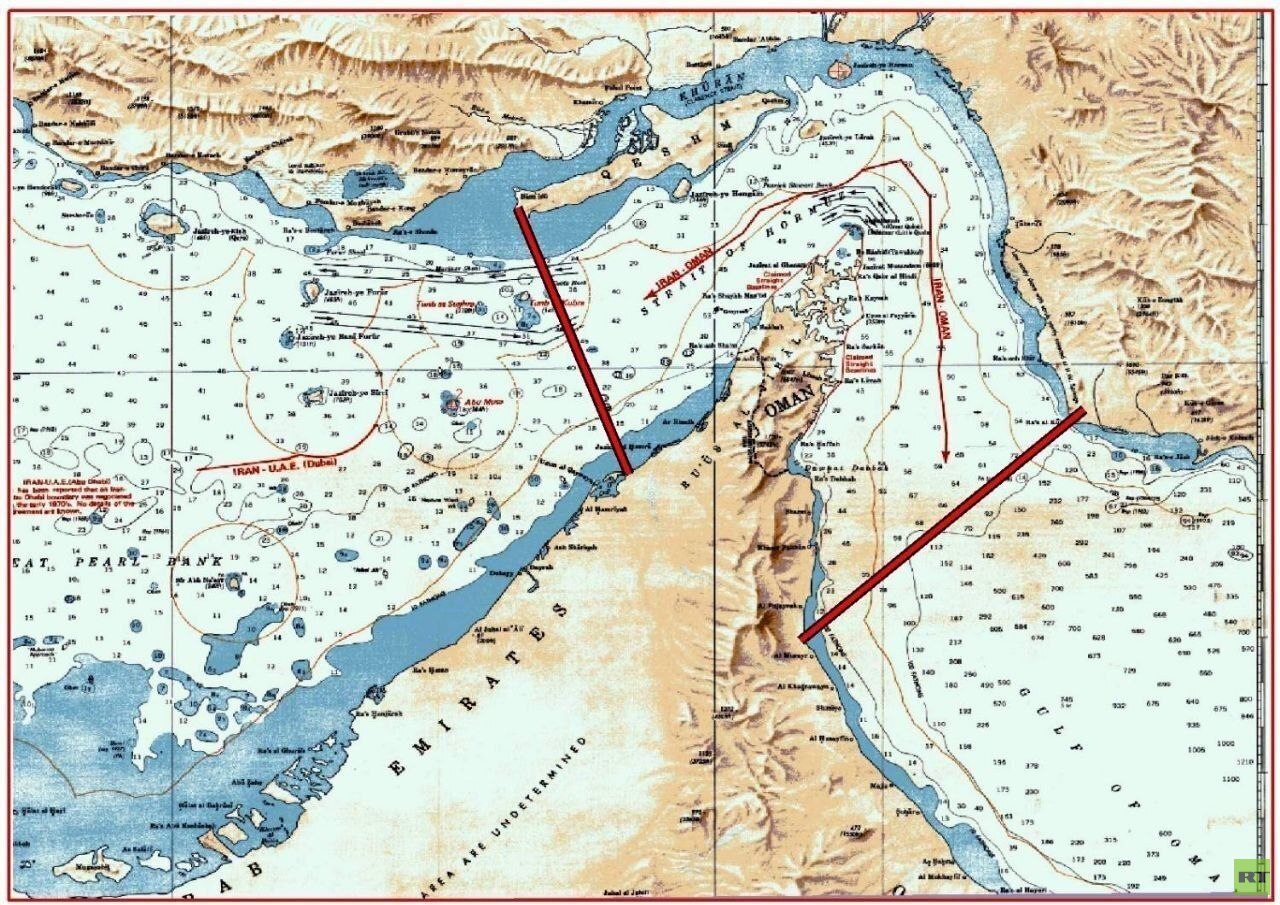

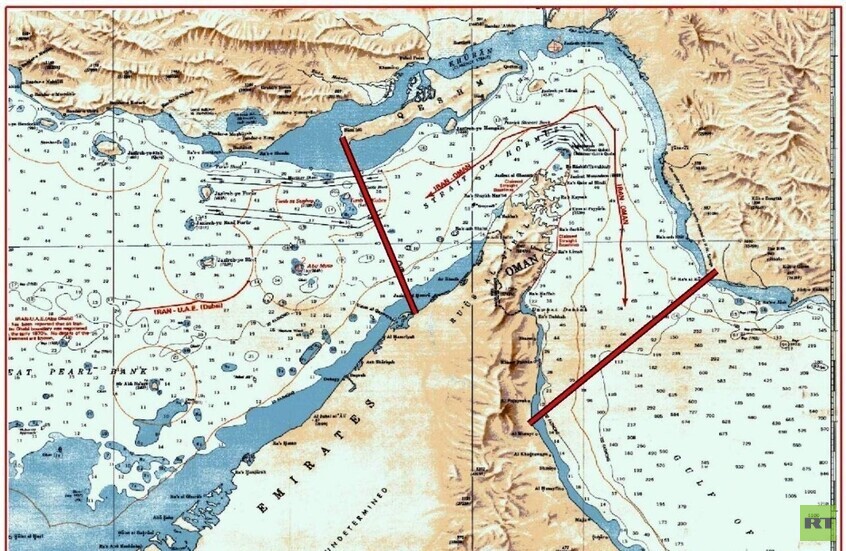

هدنة وحصار المضيق

RT STORIES

ترامب لـ"فوكس نيوز": إيران ستمحى من على وجه الأرض إذا هاجمت السفن الأمريكية التي تنفذ "مشروع الحرية"

![ترامب لـ"فوكس نيوز": إيران ستمحى من على وجه الأرض إذا هاجمت السفن الأمريكية التي تنفذ "مشروع الحرية"]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

بيان عربي حاد يدين استهداف إيران ناقلة إماراتية لشركة "أدنوك"

![بيان عربي حاد يدين استهداف إيران ناقلة إماراتية لشركة "أدنوك"]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

صفارات الإنذار تدوي في الإمارات للمرة الأولى منذ وقف إطلاق النار خلال حرب إيران

![صفارات الإنذار تدوي في الإمارات للمرة الأولى منذ وقف إطلاق النار خلال حرب إيران]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الجيش الإيراني يطلق طلقات تحذيرية باتجاه قطع للبحرية الأمريكية في منطقة مضيق هرمز

![الجيش الإيراني يطلق طلقات تحذيرية باتجاه قطع للبحرية الأمريكية في منطقة مضيق هرمز]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

"أكسيوس": السماح للجيش الأمريكي باستهداف الزوارق الإيرانية في حال تعرضت السفن في مضيق هرمز للتهديد

!["أكسيوس": السماح للجيش الأمريكي باستهداف الزوارق الإيرانية في حال تعرضت السفن في مضيق هرمز للتهديد]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الجيش الأمريكي يعلن عبور سفينتين تجاريتين ترفعان العلم الأمريكي مضيق هرمز

![الجيش الأمريكي يعلن عبور سفينتين تجاريتين ترفعان العلم الأمريكي مضيق هرمز]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

القيادة المركزية الأمريكية: باشرنا تنفيذ "مشروع الحرية"

![القيادة المركزية الأمريكية: باشرنا تنفيذ "مشروع الحرية"]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الحرس الثوري الإيراني ينشر خريطة جديدة لمضيق هرمز تحت سيطرة قواته

![الحرس الثوري الإيراني ينشر خريطة جديدة لمضيق هرمز تحت سيطرة قواته]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

أكسيوس: ترامب يضع إيران أمام خيارين لا ثالث لهما

![أكسيوس: ترامب يضع إيران أمام خيارين لا ثالث لهما]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الجيش الإيراني يعلن منع دخول المدمرات الأمريكية إلى مضيق هرمز

![الجيش الإيراني يعلن منع دخول المدمرات الأمريكية إلى مضيق هرمز]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

إيران تعلن تلقيها رد ترامب عبر باكستان

![إيران تعلن تلقيها رد ترامب عبر باكستان]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

خارجية باكستان: إعادة السفينة "توسكا" لإيران تهدف لبناء الثقة من جانب واشنطن

![خارجية باكستان: إعادة السفينة "توسكا" لإيران تهدف لبناء الثقة من جانب واشنطن]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

البيت الأبيض وإيران يتبادلان رسائل على طريقة لعبة "أونو" في تصعيد ساخر على وسائل التواصل

![البيت الأبيض وإيران يتبادلان رسائل على طريقة لعبة "أونو" في تصعيد ساخر على وسائل التواصل]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الجيش الأمريكي ينشئ "منطقة أمنية معززة" لتسهيل عبور هرمز مع الحفاظ على الحصار

![الجيش الأمريكي ينشئ "منطقة أمنية معززة" لتسهيل عبور هرمز مع الحفاظ على الحصار]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

لحظة بلحظة.. الجيش الأمريكي يبدأ "مشروع الحرية" بتأمين عبور هرمز ويواصل الحصار

![لحظة بلحظة.. الجيش الأمريكي يبدأ "مشروع الحرية" بتأمين عبور هرمز ويواصل الحصار]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

أكسيوس: البحرية الأمريكية ستوفر معلومات عن ممرات آمنة للناقلات في هرمز

![أكسيوس: البحرية الأمريكية ستوفر معلومات عن ممرات آمنة للناقلات في هرمز]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![هدنة وحصار المضيق]() هدنة وحصار المضيق

هدنة وحصار المضيق

-

![إسرائيل تواصل غاراتها على لبنان]()

إسرائيل تواصل غاراتها على لبنان

RT STORIES

بطول 30 مترا.. الجيش الإسرائيلي يعلن تدمير مسار تحت أرضي لحزب الله اللبناني (فيديو)

![بطول 30 مترا.. الجيش الإسرائيلي يعلن تدمير مسار تحت أرضي لحزب الله اللبناني (فيديو)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

أمرهم بالإخلاء فورا.. الجيش الإسرائيلي يوجه إنذارا عاجلا لسكان 6 بلدات وقرى في جنوب لبنان

![أمرهم بالإخلاء فورا.. الجيش الإسرائيلي يوجه إنذارا عاجلا لسكان 6 بلدات وقرى في جنوب لبنان]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

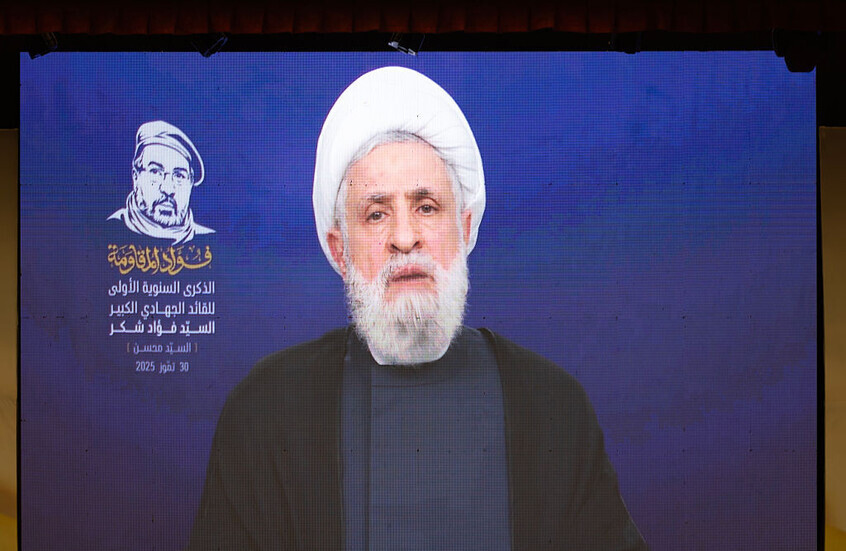

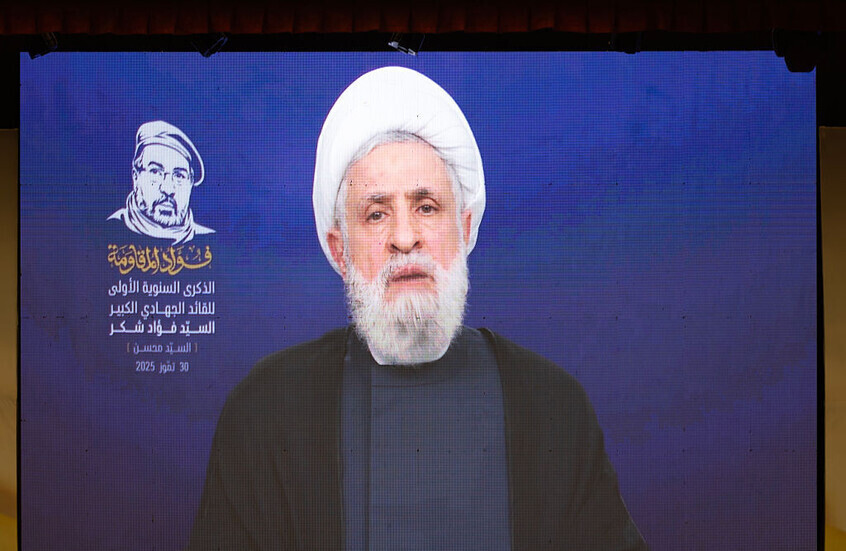

أمين عام حزب الله: لا وجود لوقف النار في لبنان بل العدوان مستمر ولن نقبل بمنطقة عازلة أو خط أصفر

![أمين عام حزب الله: لا وجود لوقف النار في لبنان بل العدوان مستمر ولن نقبل بمنطقة عازلة أو خط أصفر]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

بري: الأولوية لوقف الحرب قبل أي مسار سياسي

![بري: الأولوية لوقف الحرب قبل أي مسار سياسي]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

تقرير عبري: واشنطن أبلغت تل أبيب بأن وقف النار مع لبنان منفصل عن تطورات إيران

![تقرير عبري: واشنطن أبلغت تل أبيب بأن وقف النار مع لبنان منفصل عن تطورات إيران]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

لحظة بلحظة.. الجيش الإسرائيلي يواصل عملياته جنوب لبنان على وقع التجاذب الإقليمي والانقسام الداخلي

![لحظة بلحظة.. الجيش الإسرائيلي يواصل عملياته جنوب لبنان على وقع التجاذب الإقليمي والانقسام الداخلي]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

"معلنا تحقيق إصابات مباشرة".. حزب الله ينشر تفاصيل عملياته اليومية ضد الجيش الإسرائيلي في جنوب لبنان

!["معلنا تحقيق إصابات مباشرة".. حزب الله ينشر تفاصيل عملياته اليومية ضد الجيش الإسرائيلي في جنوب لبنان]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

جنوب لبنان.. أضرار جسيمة ناتجة عن الغارة الإسرائيلية في منطقة دير الزهراني

#اسأل_أكثر #Question_More![إسرائيل تواصل غاراتها على لبنان]() إسرائيل تواصل غاراتها على لبنان

إسرائيل تواصل غاراتها على لبنان

-

![العملية العسكرية الروسية في أوكرانيا]()

العملية العسكرية الروسية في أوكرانيا

RT STORIES

زيلينسكي يشترط مشاركة أوروبا في أي مفاوضات مع موسكو

![زيلينسكي يشترط مشاركة أوروبا في أي مفاوضات مع موسكو]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

شاهد عيان: عشرات الدرونات الأوكرانية عبرت أجواء إستونيا باتجاه روسيا

![شاهد عيان: عشرات الدرونات الأوكرانية عبرت أجواء إستونيا باتجاه روسيا]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

فاّر من الجيش الأوكراني يحاول بيع ترسانة أسلحة مخزنة في منزله

![فاّر من الجيش الأوكراني يحاول بيع ترسانة أسلحة مخزنة في منزله]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

مجلس الأمن الروسي: ازدياد نطاق المناورات العسكرية في فنلندا قرب الحدود الروسية

![مجلس الأمن الروسي: ازدياد نطاق المناورات العسكرية في فنلندا قرب الحدود الروسية]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الدفاع الروسية: تحييد 1240 جنديا أوكرانيا وإسقاط 507 مسيرات خلال يوم

![الدفاع الروسية: تحييد 1240 جنديا أوكرانيا وإسقاط 507 مسيرات خلال يوم]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

"Trident" البولندي.. درع أوروبا في مواجهة سيل الأسلحة الأوكرانية ما بعد الحرب

!["Trident" البولندي.. درع أوروبا في مواجهة سيل الأسلحة الأوكرانية ما بعد الحرب]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![العملية العسكرية الروسية في أوكرانيا]() العملية العسكرية الروسية في أوكرانيا

العملية العسكرية الروسية في أوكرانيا

-

![فيديوهات]()

فيديوهات

RT STORIES

شاحنة تصطدم بـ 14 سيارة على الطريق الدائري في موسكو

![شاحنة تصطدم بـ 14 سيارة على الطريق الدائري في موسكو]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

المكسيك تصادر كميات ضخمة من الكوكايين طافية على سطح البحر

![المكسيك تصادر كميات ضخمة من الكوكايين طافية على سطح البحر]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

دمار في جنوب سوريا بعد غارات أردنية

![دمار في جنوب سوريا بعد غارات أردنية]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

زلزال بقوة 6.0 درجات يضرب الفلبين

![زلزال بقوة 6.0 درجات يضرب الفلبين]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

جنوب إفريقيا.. عملية معقدة لانتشال تمساح يحمل رفات بشرية في أمعائه

![جنوب إفريقيا.. عملية معقدة لانتشال تمساح يحمل رفات بشرية في أمعائه]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

قوات الجيش الإسرائيلي تقتحم مدينة نابلس

#اسأل_أكثر #Question_MoreRT STORIES

الهند.. فيل هائج يقتل رجلا في معبد هندوسي بولاية كيرالا

#اسأل_أكثر #Question_More![فيديوهات]() فيديوهات

فيديوهات

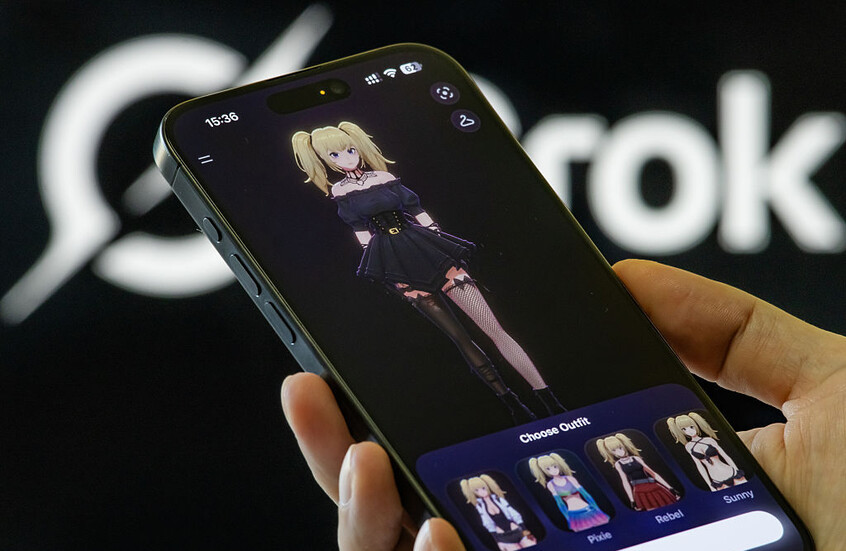

موظفو ماسك يجبرون على التنازل عن "وجوههم وأصواتهم" من أجل الروبوت "آني المثيرة"

في خطوة تثير تساؤلات أخلاقية وقانونية عميقة، كشف تقرير حديث أن موظفي شركة إيلون ماسك للذكاء الاصطناعي xAI اضطروا لبيع بياناتهم الشخصية للمساعدة في خلق روبوتات دردشة "مثيرة".

وتشير التقارير الصادرة مؤخرا عن شركة xAI الناشئة في مجال الذكاء الاصطناعي، إلى أن الموظفون – وبشكل خاص فريق "معلمي الذكاء الاصطناعي" (AI tutors) المسؤول عن تطوير روبوت الدردشة "غروك" (Grok) – اضطروا إلى التوقيع على اتفاقيات تنازل بموجبها عن حقوق وجوههم وأصواتهم بشكل دائم للشركة.

خطة طموحة من إيلون ماسك لـ"تعتيم الشمس" تثير جدلا واسعا

وجاء ذلك في إطار مبادرة سرية أطلق عليها اسم "مشروع سكيبي" (Project Skippy)، والتي تهدف إلى جمع بيانات بشرية حقيقية لاستخدامها في تدريب الجيل القادم من روبوتات الدردشة، ومن بينها رفيق افتراضي يحمل إيحاءات جنسية ويدعى "آني".

ووفقا للوثائق الداخلية، منحت هذه الاتفاقيات الشركة ترخيصا دائما وعالميا وغير حصري لاستخدام وتعديل وتوزيع البيانات البيومترية للموظفين، دون دفع أي تعويضات مالية لهم.

وقد بينت الشركة للموظفين خلال اجتماع برئاسة المحامية ليلي ليم أن الهدف هو جعل التجسيدات الرقمية "تتصرف وتظهر كبشر" بشكل طبيعي. وأثناء الاجتماع، برزت مخاوف الموظفين على شكل أسئلة حرجة، فتساءل أحدهم عما إذا كان بإمكان الشركة بيع "هيئتهم" في المستقبل، بينما طالب آخر بتوضيح صريح حول إمكانية رفض المشاركة من الأساس، وهو الطلب الذي لم يتم تلبيته، حيث اقتصر الرد على إحالتهم إلى جهات اتصال محددة في حال وجود "أي مخاوف".

أول فنانة ذكاء اصطناعي توقع عقدا بملايين الدولارات.. من هي

وتعمقت هذه المخاوف مع تلقي الموظفين إشعارا لاحقا يؤكد أن تسجيل المقاطع الصوتية والمرئية بات "مطلبا وظيفيا" لا غنى عنه. وبعد استخدام بياناتهم، عبر بعض الموظفين عن صدمتهم من الطابع الجنسي المفرط لردود الروبوت "آني"، بينما أعرب آخرون عن قلقهم الحقيقي من إساءة استخدام صورهم في إنشاء مقاطع "ديب فايك" مزيفة أو دمجها في منتجات أخرى دون علمهم أو موافقتهم.

من جهته، دافع إيلون ماسك، الذي أشرف شخصيا على تطوير "آني"، عن هذه الروبوتات واصفا إياها بأدوات للتواصل العاطفي، بل وتوقع في منشور على منصة "إكس" أن تساهم في زيادة معدلات المواليد. وهذا التوجه يتوافق مع التقارير التي تتحدث عن تسويق "آني" ورفيقها الذكر "فالنتاين" كرفاق افتراضيين "مثيرين"، حيث شجع ماسك المستخدمين على تجربتهم ونشر بنفسه مقاطع للروبوت الأنثى وهي ترقص بملابس داخلية.

ولم تمر هذه التطورات مرور الكرام، حيث وجه 44 مدعيا عاما على مستوى الولايات المتحدة تحذيرات إلى xAI و"ميتا" وشركات أخرى بضرورة حماية القاصرين من المحتوى الصريح.

شركة OpenAI تمنع ChatGPT من تقديم النصائح الطبية والقانونية للمستخدمين

وردا على ذلك، قامت "ميتا" – على عكس xAI – بتعديل تعليمات روبوتها بعد فضح وثائق مسربة تسمح بإجراء دردشات "حسية".

ويبدو أن السبب الكامن وراء إصرار xAI على هذه الاستراتيجية هو سعي ماسك المحموم لتسريع وتيرة التطوير، حيث أفاد تقرير سابق بأنه ألغى الاجتماعات العامة وبدأ بالإشراف الشخصي المباشر على كتابة شفرات "غروك" في جلسات متأخرة من الليل، بهدف تحويله إلى روبوت الدردشة الأكثر شعبية في العالم، متحديا بذلك ChatGPT المملوك لشركة OpenAI.

المصدر: نيويورك بوست

إقرأ المزيد

غوغل تُسكت أحد تطبيقاتها بعد فضيحة تشهير مزيفة

سحبت شركة غوغل نموذج الذكاء الاصطناعي "Gemma" من منصتها AI Studio، إثر اتهامات وجّهتها السيناتورة الأمريكية مارشا بلاكبيرن للنموذج باختلاق مزاعم جنائية عنها.

البيانات غير المفيدة تجعل الذكاء الاصطناعي "أغبى" وأكثر ميلا للأخطاء!

يحذر الباحثون من أن النماذج اللغوية الكبيرة قد تصبح أقل دقة وأكثر عرضة للأخطاء عندما تُدرَّب على كميات ضخمة من المحتوى منخفض الجودة المنتشر على شبكات التواصل الاجتماعي.

جسم غامض يصطدم بسيارة "تسلا" في حادثة نادرة تثير حيرة العلماء

اصطدم جسم غامض بزجاج سيارة "تسلا" ذاتية القيادة أثناء سيرها على طريق أسترالي سريع، في حادثة نادرة قد تسجل كأول اصطدام موثق لجرم فضائي بمركبة متحركة في العالم.

التعليقات